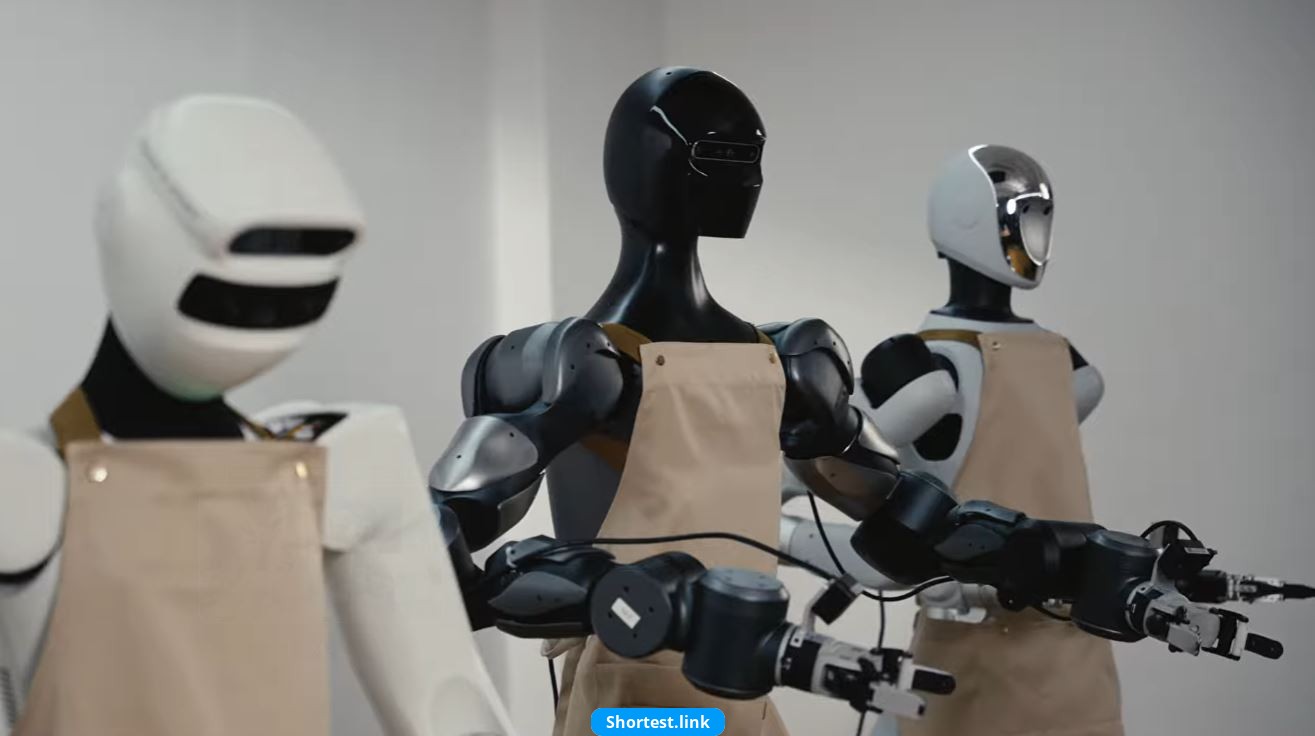

中国で開発された新世代の人工知能は、視覚、言語、動作を単一のシステムに統合し、複雑なタスクを独立して実行できるようにすることで、ロボット工学に変革をもたらすと期待されています。

視覚-言語-行動モデルとして知られるこの技術は、事前にプログラムされた指示に単に従うだけの従来のロボットからの移行を表しています。代わりに、機械が周囲の環境を解釈し、自然言語でコマンドを理解し、リアルタイムで意思決定を行うことができるようになります。

1 つの脳で複数のタスクを実行

新しく導入されたシステムと呼ばれるものは、 モツブレインは、中国のShengShu Technology社が汎用の「ロボット頭脳」として開発した。複数の特殊なシステムを、さまざまなマシンや環境に適応できる単一の統合インテリジェンス レイヤーに置き換えます。

タスクごとに個別のプログラミングが必要な従来のロボット ソフトウェアとは異なり、このモデルは認識と動作を統合します。これにより、ロボットは人間の介入なしに一連の活動を実行できるようになり、最大 10 ステップを連続して自律的に処理できる可能性があります。

このアーキテクチャは、視覚データ、言語指示、現実世界のインタラクションから同時に学習するように設計されています。この組み合わせにより、ロボットは物体を認識するだけでなく、次に何をするかを決定できるようになり、理解と実行の間のギャップを埋めることができます。

高いパフォーマンスと効率性

開発者によると、このシステムは世界的なロボット工学ベンチマークでトップランキングを達成し、ランダム化されたテスト環境での成功率が 95% を超えています。また、従来のアプローチと比較してデータ効率が大幅に向上し、大規模な再トレーニングの必要性が軽減されます。

このモデルは、ハードウェアに依存しないプラットフォームとして動作します。つまり、基礎となるインテリジェンスを再設計することなく、さまざまなタイプのロボットに展開できます。

産業や日常生活への影響

専門家らは、この種の統合AIは複数の分野を再構築する可能性があると述べている。工場では、ロボットは再プログラミングすることなく新しい生産タスクに適応できます。小売業では、在庫を管理したり、顧客をサポートしたりすることができます。自宅では、最小限の監督で家事を行うことができました。

中国はロボット工学の分野で急速に進歩しており、140社以上の企業がヒューマノイドシステムに取り組み、大規模導入を進めている。

統合された「ロボットの頭脳」の出現は、動的な現実世界の環境で動作できる完全自律型マシンへの重要なステップと見なされています。

Leave a Reply